Indice delle composizioni (fare di nuovo click sull'opera selezionata)

E'-TAPE SYNKRÒNOS THE WELL[E]S EXPERIMENT VIDEODANZAVOICING LA CADUTA DI CASA USHER NIGHT MUSIC CO2

LADIES & GENTLEMEN

MACCHINE SCRIVENTI

OCCHIOxOCCHIO

INTUS

LABOR

SOLARIA

VERTIGINE

nonSPAZIOnonTEMPO CARTE INCOGNITE

IL

SOGNO DEL DILUVIO MAMAN

MARENOSTRUM C500T

E'-TAPE

(1977)

(per nastro magnetico a 4 tracce)

Durata: 14': 20"

[Precedente] [Successivo] [Sommario] [Back]

E'-TAPE è la prima composizione realizzata nel 1977 come lavoro conclusivo per l'esame del corso di Musica Elettronica frequentato al Conservatorio Rossini sotto la guida di Walter Branchi dal 1974. Il brano è uno studio sulle possibilità offerte dalle proprietà d'interconnessione dei sistemi analogici per la produzione del suono disponibili al LEMS (Laboratorio Elettronico per la Musica Sperimentale). Oltre a questo, E'-TAPE esplora due diverse tecniche di spazializzazione del suono attraverso la riproduzione quadrifonica standard. Formalmente il brano è organizzato su sezioni diverse, ciascuna imperniata su un certo tipo di materiale sonoro, racchiuse da un'introduzione (presentazione dei materiali) e da una ricapitolazione finale.

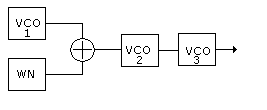

In quel periodo, Walter Branchi mi spingeva alla sperimentazione sul suono a partire da configurazioni di oscillatori controllati in tensione. Effettivamente, il brano trae origine da una particolare configurazione che faceva uso di 4 generatori di funzioni secondo lo schema seguente:

Chiamavo questa connessione "oscillatore complesso". WN era un generatore di rumore bianco , VCO 1 un generatore di impulsi con frequenza compresa tra 1 e 10 Hz mentre VCO 2 (frequenza circa 1 Hz) e VCO3 erano rispettivamente un generatore sinusoidale e un generatore di dente di sega. Ciò che accadeva era una sorta di modulazione di frequenza e regolando opportunamente i livelli di tensione e gli "offset" degli oscillatori di controllo si producevano sequenze "pseudo-melodiche" con una pronuncia di tipo quasi jazzistico, quindi in definitiva, un sequencer un po' particolare, ma sicuramente molto interessante. Ascoltavo per minuti o intere mezz'ore il procedere delle sequenze e mai riuscivo a ritrovare esattamente una stessa figurazione, un pattern che si ripeteva banalmente. Questo mi affascinava molto. Il generatore di rumore (un oscillatore Wavetek con forme d'onda periodiche e casuali) produceva sequenze pseudo-casuali utilizzando una tecnica a shift-register a 10, 15 e 20 bit. Impostato a 20 bit, le sequenze apparivano veramente casuali.

Tutto il materiale utilizzato nelle varie sezioni deriva dall'impiego di forme più o meno elaborate (filtraggio, modulazione ad anello, riverberazione) di tali sequenze. Naturalmente, una di queste sequenze, risulta come una sorta di elemento tematico dal momento che viene più volte riutilizzato e sviluppato nel corso dell'intera composizione. Se avessi deciso di registrare la sequenza precedente o seguente, forse il brano oggi suonerebbe lievementediverso, ma l'idea formale che stava dietro è ciò che alla fine rimane.

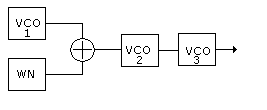

Per ciò che riguarda la spazializzazione, decisi di usare due tipologie fondamentali: la localizzazione e la rotazione. La prima la realizzai semplicemente con la tecnica del panning esclusivo sui 4 canali distribuendo il materiale su altrettante tracce di un AMPEX a 4 piste mentre per la seconda utilizzai due diverse tecniche. La prima tecnica consisteva nell'automatizzazione del panning impiegando 4 oscillatori e 4 modulatori RM utilizzati come "gate" di canale secondo lo schema seguente:

Ciascuno dei 4 oscillatori era impostato con forma d'onda sinusoidale con offset, con frequenze dell'ordine da decimi a qualche hz, con lievi differenze l'una dall'altra. Tali differenze creavano una sfasatura tra le funzioni e ciò produceva un effetto di rotazione sui 4 canali d'uscita. Ovviamente non era facile controllare la direzione, il movimento o la regolarità, ma questo faceva parte delle difficoltà da superare.

L'altro metodo di rotazione, più rigido e automatico, consisteva nell'utilizzazione del ritardo di testina dell'AMPEX a 4 piste: il segnale d'ingresso veniva iniettato nella prima traccia (testina di registrazione Ch. 1) mentre l'uscita (Tape) del Ch.1 (testina di rriproduzione Ch.1) veniva a sua volta iniettata nella seconda traccia e così via fino ad ottenere il loop seguente:

Ch1 -> Ch2 -> Ch3 -> Ch4 -> Ch1......ecc.

In questo caso le rotazioni erano molto rapide ed il verso di rotazione era quello dettato dalle connessioni dei canali d'ascolto con l'uscita dell'AMPEX. Data la particolare configurazione, il suono subiva l'effetto collaterale di una serie di echi multipli, particolarmente evidente con materiali impulsivi.

Il nome deriva da un gioco di parole tra E (Eugenio), TAPE (nastro) e ETAPE (tappa, parte di un percorso)

La prima esecuzione avvenne nel Luglio 1977 all'Auditorium Pedrotti del Conservatorio Rossini di Pesaro.

[Precedente] [Successivo] [Sommario] [Back]

VOICINGS

(1982)

edipan

edipan

(per nastro magnetico a 2

tracce) (Durata: 16':30")

[Precedente] [Successivo] [Sommario] [Back]

Voicings può dirsi il vero punto di partenza dell'attività compositiva. Il

brano trae origine, anche in questo caso, dall'esplorazione di un materiale

sonoro generato elettronicamente, basato essenzialmente su una somma di 9

oscillatori intonati circa all'unisono con forme d'onda triangolari, quadre e a

rampa. All'epoca della composizione, il LEMS era provvisto di 4 generatori di

funzioni HP, 3 Wavetek e un sintetizzatore VCS3: incluso l'LFO del VCS3 facevano

10 oscillatori (appena uno in più dello Studio di Fonologia della Rai di

Milano). La relativa instabilità di frequenza dei dispositivi e la voluta

imprecisione nell'impostazione della stessa produceva un suono corale di grande

interesse che produceva un pattern di battimenti piuttosto complesso. Il suono

iniziale (fondamentale c.a.: 152 Hz ) veniva poi modificato

timbricamente dal filtro LP risonante del VCS3 attraverso una scansione molto

lenta della frequenza di risonanza e un Q piuttosto elevato. In pratica, parte

della sezione di apertura è rappresentata da questo "gesto"

esplorativo operato con il filtro. Tutto il brano è derivato da questo

materiale iniziale elaborato progressivamente fino ad ottenere complessivamente

11 varianti (voci). L'idea era quella di costruire un microcosmo sonoro ai

confini tra l'espressività strumentale e quella strettamente elettronica

servendosi delle tecniche di quest'ultima per esprimere il concetto di

"circolarità dello spazio e del tempo, nei quali la realtà ( concreta e

astratta) vive e si trasforma continuamente, lasciando dietro sè l'eco delle

sue molteplici "voci"....

La metafora della trasformazione viene traslata sul piano sonoro attraverso un

processo di rielaborazione "recursiva" del materiale continuamente

generato adottando allo stesso tempo un criterio di selezione che producesse

modificazioni graduali. Nella parte conclusiva del brano viene utilizzato il

glissato continuo con chiara ispirazione al glissato infinito di Risset e

Shepard, anche se realizzato empiricamente attraverso 3 anelli di nastro

controllati manualmente dal mixer.

Il titolo è ancora una volta un gioco di parole tra l'evocazione della parola "voce" e il termine impiegato nella pratica jazzistica che indica la qualità dell'armonizzazione (disposizione delle parti, distribuzione, concatenazione, ecc..)

Tecnicamente, il lavoro è stato realizzato facendo ampio uso dell'accumulazione magnetica, della retrogradazione dei materiali e della variazione di velocità di scorrimento del nastro. Alcuni elementi di controllo (funzioni d'inviluppo d'ampiezza) sono generati per la prima volta all'interno del Laboratorio con tecnica digitale facendo uso di un sistema microcompter SYM-1 (Syntertek 6502) dotato di un convertitore a 8 bit autocostruito e di un software rudimentale scritto in linguaggio Assembly.

Estratto dalla partitura 1(htm)

Download Partitura

![]() (pdf)

(pdf)

La prima esecuzione di Voicings risale al 1982 al V Festival di Musica Verticale ( Sala Casella - 1982 - ROMA ) .

Il brano ha ottenuto una Menzione d'Onore all'11° International Electroacoustic Music Competition di Bourgesn ed è stato eseguito in molte occasioni in concerto e varie volte in RAI.

E' stato pubblicato da EDIPAN per la collana IN SOUND (1) - PAN PRC S20 - 15 Stereo

Scrive di Voicings Nicola Sani: Voicings di Eugenio Giordani, conclude il primo volume (della collana In sound n.d.r.). .. Si tratta di un lavoro di grande maturità compositiva, non alieno da significati evocativi piuttosto intensi. Riflette una notevole tensione interiore ed è senz'altro il lavoro più coinvolgente di tutto l'album....

[Precedente] [Successivo] [Sommario] [Back]

LADIES & GENTLEMEN

(1986)

(per suoni elettronici a due tracce)

(Durata: 7' : 30")

[Precedente] [Successivo] [Sommario] [Back]

La genesi di Ladies & Gentlemen è legata a diversi fattori che hanno

contribuito in modo determinante alla sua realizzazione. Anzitutto la

possibilità di utilizzare un sistema digitale per la generazione del suono

progettato all'Iselqui di Ancona dagli ingegneri Renzo Pezzani e Sandro

Gabrielli (hardware) e gli ingegneri Gemma Avio e Mauro Troiani

(software).

Questo sistema era stato progettato per fornire alle aziende del settore

elettro-musicale un nuovo approccio alla sintesi del suono, fino ad allora

prevalentemente di tipo analogica o al più ibrida. Il sistema era in definitiva

un sintetizzatore a forma d'onda fissa (wavetable synthesizer) nel quale era

possibile concatenare e interpolare un numero variabile di tabelle d'onda.

Poichè il mio compito era quello di sperimentare le possibilità

applicative, trovai interessante la possibilità di produrre sonorità di tipo

inarmoniche, (per esempio ad imitazione del classico suono FM) sfruttando ciò

che in gergo viene chiamato "harmonic trick". L'idea è molto

semplice: dal momento che un generatore di suono a forma d'onda fissa può

produrre per definizione solo suoni armonici, impiegando forme d'onda costituite

da somme di componenti parziali a partire dal 16° armonico in su e trasponendo

di varie ottave la frequenza fondamentale nella zona grave, si potevano ottenere

timbri a caratteristica tipicamente inarmonica.

La generazione dei suoni era prodotta da 16 oscillatori in grado di leggere una memoria di wavetable precaricata attraverso un sistema di sviluppo a microprocessore. La sequenza delle wavetable interpolate era controllata da un programma che ne schedulava la progressione nel tempo. Era possibile in questo modo creare suoni timbricamente variabili nel tempo con gradualità.

L'altro fattore determinante fu suscitato in me dall'ascolto di un brano di Andy Moorer (Gentlemen Start Yours Engines basato su un testo poetico di Richard Brautigan, "Lions Are Growing") nel quale il materiale vocale originario viene elaborato con tecniche di speech syntesis. Non possedendo a quel tempo alcun sistema per la sintesi del parlato, utilizzai il sintetizzatore Iselqui per le voci maschili e una tecnica sottrattiva analogica per le voci femminili.

Da un punto di vista formale il brano è imperniato su un duetto tra

due pseudo-voci femminili e che appare, dopo una parte iniziale

costituita dalla sovrapposizione di timbri inarmonici lentamente glissanti in

frequenza che si trasformano in una sonorità tipicamente corale (suoni vocali

di tipo maschile) e quindi armonica. Il senso che assume il glissando è quello

di una cadenza senza risoluzione, anche se a volte se ne ravvisa la fugace

presenza.

Prima del duetto che inizia a 4':38" circa, le due caratteristiche vocali

(maschile e femminile) introducono un materiale a fascia di chiaro riferimento

FM. Il duetto è preceduto immediatamente da un materiale pseudo-corale e termina con un vocalizzo sovrumano

(forse inconsciamente ispirato alla voce di soprano che si smaterializza nel

Poème Electronique di Varèse),. Il brano accenna poi ad una ripresa sovrapposta ad

un materiale ancora inarmonico che pulsa ossessivamente....Appare, oggi come

allora, un brano incompleto, quasi un episodio di un opera di più ampio

respiro, forse sempre inseguita, mai compiuta.

In ogni caso il brano venne eseguito in varie occasioni e la prima fu all'Electronic Art Festival presso l'Università degli Studi di Camerino nell'anno della sua realizzazione. Il materiale digitale è stato prodotto presso l'Iselqui di Ancona mentre il montaggio e alcune parti sono state realizzate al LEMS (Conservatorio di Musica Rossini di Pesaro)

[Precedente] [Successivo] [Sommario] [Back]

SOLARIA

(1988)

(per suoni elettronici a due tracce)

(Durata: 11' : 43")

[Precedente] [Successivo] [Sommario] [Back]

Solaria è il primo lavoro che utilizza, oltre ai suoni elettronici,

soprattutto suoni elaborati di pianoforte. Durante i seminari di Musica

Complessità ove ho conosciuto e frequentato per nove giorni Barry Truax, ho

avuto modo di approfondire la tecnica di sintesi conosciuta come Sintesi

Granulare. Subito dopo ho iniziato a pensare ad un brano che utilizzasse tale

tipo di sintesi in combinazione con la sintesi "wavetable" utilizzata

in Ladies & Gentlemen". Tra il 1985 e il 1988 avevo a disposizione

presso l'Iselqui di Ancona, un computer VAX 730 e 785 e dapprima una

versione Music 11 che girava (a fatica) in ambiente VMS e successivamente una

delle primissime versioni di Csound. L'idea compositiva di Solaria nasce quindi

dalla possibilità di esplorare l'essenza timbrica dei suoni di pianoforte

attraverso due processi di sintesi rispettivamente basati sull'analisi in

frequenza e sull'elongazione temporale dei suoni precedentemente registrati.

Il materiale derivava da un database di suoni di pianoforte

utilizzato per realizzare uno strumento digitale a campionamento per

un'azienda elettro-musicale. Il database era costruito analizzando in frequenza

i suoni originali e producendo "waveform" che esprimevano i cambi

spettrali più significativi secondo un procedimento che oggi potremmo anche

assimilare alla Group Additive Synthesis. Le forme d'onda del database

rappresentavano una sorta di materiale "distillato" armonico, privato

della componente temporale e di quegli elementi caratterizzanti che sono

per esempio i rumori e le forti inarmonicità presenti nel suono d'origine. Una

parte dei suoni, specialmente quella che caratterizza la parte iniziale del

brano, sono ottenuti interpolando e sovrapponendo il materiale armonico formato

da insiemi di "waveform" mentre la restante parte è affidata alla

granulazione dei suoni d'origine, così come erano dalla registrazione. Nella

sezione centrale, che definisce l'elemento estraneo, vengono usati gruppi di 6

suoni sinusoidali organizzati secondo serie geometriche di ragione 1.5.

La sezione finale riutilizza il materiale armonico secondo una doppia serie di

glissati infiniti, ascendente e discendente, applicando quasi alla lettera

la tecnica già impiegata da Risset.

L'idea extra-musicale a cui si ispira Solaria è legata al clima fantascientifico di "Fondazione e Terra" di I. Azimov ed in particolare dal capitolo che tratta del pianeta Solaria, delle sue grotte sotterranee, dei suoi robots minacciosi, dell'incanto e della paura dell'ignoto. L'intero brano rappresenta infatti la metafora di un viaggio interplanetario, di un avvicinamento, di un approccio, di una drammatica ripartenza....

Credo di aver sognato, in un letto d'ospedale e sotto gli effetti dell'anestesia per un lieve intervento, il clima sonoro e tutta l'organizzazione formale del brano.

Da un punto di vista strettamente tecnico, Solaria è stato realizzato prevalentemente con la Sintesi Granulare implementa con Csound. Il codice della sintesi è riportato integralmente nel volume "Il Suono Virtuale" di R. Bianchini e A.Cipriani (Ed. Contempo). E' interessante notare come in quel periodo, Csound non disponeva di un modulo di granulazione, quindi fui costretto a realizzarlo con gli "opcode" allora disponibili. La prima implementazione fu realizzata su un computer VAX 785 in ambiente VME e successivamente su PC sfruttando una versione di Csound "portata" in ambiente DOS su PC con l'aiuto di Francesco Castelli (ingegnere elettronico). Era stupefacente vedere un PC di allora (un 286 o massimo un 386) generare migliaia di grani al secondo (ovviamente non in tempo reale). Quando informai Barry Truax di questo piccolo successo, ricevetti un feedback da parte di Otto Laske al quale Barry aveva riferito del programma. Ecco qui riprodotta la lettera di Otto Laske poichè mi sembra importante riportare questo particolare che forse non è troppo conosciuto.

Solaria - (mp3) Da 7':05 a 8':52" (Sonogramma)

Nel 1988, "Solaria"

ha ricevuto il 3° premio assoluto al Concorso Internazionale Newcomp

(New England Computer Art Association)

IL SOGNO DEL DILUVIO

(1997) (co-autore assieme a David Monacchi)

(musica elettroacustica

e "live electronics" per azione scenica ispirata ai disegni di Magdalo

Mussio)

Questo lavoro è stato realizzato quasi

interamente con il sistema di sintesi in tempo reale Kyma-Capybara utilizzando

quasi esclusivamente la Sintesi Granulare e il Phase Vocoder come strumenti di

generazione del materiale sonoro. Da un punto di vista operativo, le varie parti

dell'azione scenica vengono "accompagnate" dall'esecuzione

"live" del processore di sintesi attraverso una tastiera e 8 slider

per il controllo dei parametri.

Il materiale di partenza è costituito principalmente o da frammenti di testo

pre-registrato su files o direttamente dai microfoni degli attori operanti nello

spazio scenico. Dal punto di vista operativo, l'intero lavoro è suddiviso in

scene e per ciascuna di esse sono state create altrettante configurazioni del

processore (patches) richiamate in tempo reale attraverso un pannello di

controllo virtuale che simula il meccanismo del "program change".

Dal momento che i vari algoritmi possono essere molto diversi tra di loro e di

una complessità rilevante, il tutto è reso possibile attraverso una

particolare condizione (Compiled Sound Grid) operativa del software (Kyma)

che consente di "precompilare" su disco le varie patches.

In questo modo, il richiamo di una nuova patch risulta essere praticamente

immediato. Una parte del suono viene prodotto in differita (CD-DAT) in

combinazione con interventi di flauto medievale suonato da David Monacchi.

L'intera performance si è svolta sfruttando gli spazi dell'atrio del Palazzo Comunale di Cagli (due capienti androni comunicanti) nel quale prendevano posto in modo indistinto le installazioni, gli attori e gli esecutori elettroacustici.

"Il Sogno del Diluvio" è stata la mia prima esperienza compositiva con Kyma.

Nota curiosa: Ho reincontrato Augusto Spadoni (il regista) che è stato il mio esaminatore all'esame di.....Fisica I all'Università di Ancona nel lontano 1974 !!?!! Strano e piccolo il mondo...

[Precedente]

[Successivo] [Sommario]

[Back]

GLIDE (1999)

[Precedente] [Successivo] [Sommario] [Back]

[Under construction]

SYNKRÒNOS

(2000)

(per pianoforte, suoni di

sintesi e live electronics)

Il pianoforte è uno strumento che difficilmente

sfugge alla sua ineluttabile natura. Quando i martelli abbandonano il meccanismo

che li sospinge non esiste nessuna possibilità di controllarne ulteriormente il

movimento e il gioco è fatto... Una sola nota pesa come un macigno e fa

riaffiorare immediatamente tutta quella gigantesca memoria musicale che vi è

implicata. Anche le ingegnose virtuosissime artefazioni timbriche di

Cage non hanno risolto problema...Sono stato sempre restio a scrivere una

composizione che prevedesse il pianoforte in combinazione con i suoni

elettronici proprio per la difficoltà di sottrarsi ai troppi vincoli che tale

strumento pone. In questo brano ho deciso alla fine di non oppormi, ma ho cercato di

assecondare la sua natura e di ampliare e magnificare alcune sue caratteristiche...

Il suono del pianoforte

amplificato, i suoni elettronici registrati in studio e l’elaborazione

digitale dal vivo sono gli elementi base di questa composizione. L’intero

brano è costruito sull’articolazione dialettica di altrettanti piani

espressivi. Nelle elaborazioni in

studio e dal vivo, il materiale prodotto è derivato sempre dal suono acustico

del pianoforte che, pur apparendo notevolmente trasfigurato, mantiene ancora

molte delle caratteristiche timbriche originali.

Le due dimensioni che

integrano quella del pianoforte solo, sono state pensate come processi di

magnificazione delle qualità timbriche del suono originale e l’insieme è

stato immaginato come una metafora pittorica di una “figura visibile e

reale” (il pianoforte) e di “figure normalmente invisibili ma virtualmente

esistenti” (i suoni prodotti in studio e l’elaborazione dal vivo). Queste

ultime sono ottenute attraverso una ricomposizione

sintetica del tempo che si rende possibile con la Sintesi Granulare, con la

tecnica del Phase Vocoder e con una combinazione incrociata delle due. Dato

l’elevato livello di trasformazione introdotto da tali tecniche, la scrittura

della parte del pianoforte non prevede particolari “effetti” o

“preparazioni” di sorta. La struttura del brano si articola in due

macro-sezioni formalmente non separate, ma sensibilmente contrastanti: la prima

vede il pianoforte come elemento gerarchicamente paritetico e “concertante”

con il suono elettronico mentre nella seconda il suono di sintesi assorbe e

integra gradualmente, ma inesorabilmente lo strumento stesso. Inoltre, le

altezze nella prima sezione sono costituite da brevi frasi che privilegiano

l’intervallo di seconda minore e che derivano tutte da una figurazione

composta due arpeggi ascendenti. Nella seconda sezione (che si

configura come una coda estesa) le altezze sono organizzate come “pattern”

(sequenze cicliche) che l’esecutore interpreta con una certa libertà e che si

inseriscono in un tessuto sonoro pre-elaborato costituito da un’elongazione

temporale degli arpeggi originali e che vengono “catturate” ed espanse

temporalmente e timbricamente dall’elaborazione del processore Kyma. In questa

fase l’esecutore condiziona in modo del tutto estemporaneo l’intervento

dell’elaborazione.

In questa fase viene attivato un algoritmo che in base ad una soglia di ampiezza

prefissata, innesca un processo di

cattura del suono in un buffer quando il suono prodotto dal pianoforte raggiunge

e supera tale soglia. Quando il buffer è pieno (circa 6 sec.) il materiale

registrato viene sottoposta a granulazione. Questo brano è

dedicato a mia figlia Elena.

LA CADUTA DI CASA USHER

Clip

WMF

screenplay: dall'omonimo racconto di E.A. Poe

Ideazione, riduzione del testo e

riprese del materiale video : Roberto Vecchiarelli

Realizzazione del dipinto, origine delle immagini video : Alessia

Manzone

assistente alla fotografia (dv): Emanuele Bertoni

editing: Raffaele Mariotti, Roberto Vecchiarelli

musica: Eugenio Giordani

voce recitante: Lucia Ferrati

"Un'immagine dipinta. Una voce

fuori campo.

Un suono prodotto elettronicamente.

Nella scrittura di Poe c'è una forte

visività e atmosfera.

Il

protagonista di Casa Usher posa lo sguardo analizzando le apparenze che messe in

luce appaiono incombenti e pervase d'inquietudine."

Questo lavoro è stato presentato nello Spazio Video della 39° Mostra Internazionale del Nuovo Cinema di Pesaro con il titolo "Il Suono delle Immagini, immagini del suono".

....L'idea scaturisce dalla possibilità diretta di una proiezione sul piano sonoro delle sole immagini, in condizione statiche o dinamiche. Una sorta di "sonificazione" che tenta di trasformare la struttura delle immagini o di loro sottoinsiemi in corrispettivo sonoro, attraverso un processo di corrispondenza, in parte in forma evocativa e in parte mediato solo dalla scelta del particolare metodo di trasformazione scelto dai rispettivi parametri di controllo, riducendo così al minimo il lavoro di feedback compositivo sui risultati intermedi.... I suoni elettronici sono stati generati in parte con Kyma e in parte con Csound.

[Precedente] [Successivo] [Sommario] [Back]

MACCHINE SCRIVENTI (2003)

(Durata: 1':00")

screenplay: Beatrice

Pucci

musica: Eugenio Giordani

Anche questo lavoro è stato presentato nello Spazio Video della 39° Mostra Internazionale del Nuovo Cinema di Pesaro con il titolo "Il Suono delle Immagini, immagini del suono".

....Generare un'atmosfera misteriosa, dove la macchina da scrivere diventa autonoma e dà vita ad un nuovo mondo carico di ombre e di personaggi ambigui. Tutto si genera con i meccanismi della macchina entrati in funzione per conto proprio e svanisce in un mare di cotone prodotto dalla macchina stessa. Strappare un oggetto dalla propria condizione abituale e collocarlo in un altro contesto, produce un senso di disordine e smarrimanto della realtà...

A dispetto della breve durata, appena un minuto, questo lavoro è stato molto impegnativo, soprattutto per la brevità. Siamo nei tempi tipici degli spot pubblicitari e come si può immaginare, è difficile organizzare musicalmente (nel senso tradizionale) e compiutamente una composizione. Ma il video è senza dubbio molto ben strutturato e questo mi ha favorito. L'unica regola che ho cercato di seguire è la consistenza dimensionale tra la durata complessiva e il materiale scelto. Un solo "click" registrato digitalmente sarebbe stato sufficiente per organizzare il suono. Non c'è altro se non il secco scacco di un tasto che viene elaborato, soprattutto al fine di attenuare se non cancellare il senso della mera rumoristica cinematografica.

screenplay: Anna

Ferrandes

musica: Eugenio Giordani

..Un viaggio introspettivo attraverso la nebbia, il dolore, la delusione, fino alla nascita di una nuova consapevolezza....

Quando Anna Ferrandes mi fece visionare il video questo aveva già una parte musicale. Il clima che tale musica evocava era quello di una struggente melanconia. Le immagini però erano molto più forti e drammatiche. Ho cercato di sottolineare questa maggiore drammaticità. Anna era preoccupata di questa piccola rivoluzione, ma quando udì la musica si sorprese di come questa nuova chiave di lettura fosse altrettanto efficace e attrattiva.

[Precedente] [Successivo] [Sommario] [Back]

THE WELL[E]S

EXPERIMENT (Video installazione

e Video con audio) (2005) (Durata : 70'

c.a.)

Video installazione

http://www.kontrotempo.it/segnaliluminosi/pescheria

MP3 "Epilogo" (estratto della parte musicale)

concept: Roberto

Vecchiarelli

coordinamento tecnico: Raffaele Mariotti- Luca Vagni

produzione e real.tecnica: Sound D Light

video: Francesca Bonci-Raffaele Mariotti-Mauro Santini

Luca Vagni - Roberto

Vecchiarelli - Luisa Villi

voce : Lucia Ferrati

registrazione voce : Luca Marzi

musica: Eugenio Giordani

[Precedente] [Successivo] [Sommario] [Back]

NIGHT

MUSIC (Sonorizzazione di "Hand

Painted Movies" di Stan Brackage) (2005) (Durata :

35' c.a.)

Clip WMF ("Black

Ice")

Clip WMF ("Black

Ice")

Con : Roberto Vecchiarelli e Raffaele Mariotti

Musica : Eugenio Giordani

“In assenza di materiale concreto a cui riferirsi ho deciso di creare una dimensione parallela rispetto a ciò che di estremamente musicale è racchiuso in questi cortometraggi interamente realizzati sulla pellicola da Brackage. Ciò che colpisce maggiormente è il ritmo incalzante delle varie pulsazioni che si susseguono e si sovrappongono, creando relazioni di tensione-rilassamento molto vicine a ciò che avviene nel campo musicale. Il materiale sonoro è sia concreto che di sintesi, ma in generale fortemente elaborato e trasfigurato attraverso il processo di de-ristrutturazione del suono prodotto dalla sintesi granulare. In realtà, ogni cortometraggio è stato sonorizzato con una tecnica compositiva legata in parte all’interpretazione estemporanea e al successivo montaggio di processi elaborativi, mantenendo il più possibile le sincronizzazioni solo relativamente a momenti topici, ma non rinunciando al gioco dialettico in apparente de-correlazione temporale”.

[Precedente] [Successivo] [Sommario] [Back]

occhioXocchio (Musica per video) (2006) (Durata : 20 ' )

Lavoro collettivo con : Roberto Vecchiarelli e Raffaele Mariotti

Sherlock Holmes occhioXocchio: schermi, labirinti, sguardi

“Questo lavoro nasce dalla collaborazione del Corso di Storia dello Spettacolo dell’Accademia di Belle Arti di Urbino con il LEMS e la Facoltà di Lingue e Letterature Straniere dell’Università di Urbino. Un ‘collettivo’ che si è mosso con l’obiettivo di realizzare un intrattenimento nella forma di installazione video-sonora per una Giornata di Studi dal titolo ‘Sherlock Holmes nel Paese dei Media’ organizzata dalla Facoltà di Lingue. Sherlock Holmes è un soggetto particolarmente trattato da diversi media e, in particolare, dal cinema. Giocando su alcuni meccanismi e citazioni cinematografiche abbiamo creato, con la tecnica del found footage, una serie di ripetizioni, frammenti, sintassi sbriciolate, eccedenze, producendo un flusso di avvenimenti e una rete di relazioni del tutto effimere. Porte, finestre, finestrini, buchi della serratura, aperture, diventano metafore dello schermo. Assassini, vittime, investigatori, presunti colpevoli, future vittime, morti, personaggi apparentemente estranei agli accadimenti, sono gli uni per gli altri come spettacoli da osservare al di là di uno schermo.

Le sequenze sono tratte da:

Terrore di notte

R.W. Neill

Il testamento di Orfeo J. Cocteau

Le sang d’un poéte J.

Cocteau

Vampyr

C. T. Dreyer

La linea generale

S. Ejzenstejn

Ottobre

S. Ejzenstejn

L’ora del lupo

I. Bergman

Il processo

O. Welles

Esistenze senza vita

autore ignoto

La parte sonora di questo lavoro è essenzialmente basata sulla dialettica tra due tipologie acustiche: il suono concreto dei treni in corsa e alcuni "drones" sintetici. Come ormai accade spesso nei miei lavori, la componente musicale si fonde e trasmuta continuamente nell'effetto e viceversa. Data il carattere pseudo-narrativo delle immagini il suono assume a tratti l'articolazione di un vero e proprio commento sonoro, non senza alcuni "sincro" in alcuni momenti che formalmente generalmente segnano il passaggio tra una sezione a quella successiva.

[Precedente] [Successivo] [Sommario] [Back]

nonSPAZIOnonTEMPO (Musica per installazione) (2006) (Durata 25 ')

http://www.exibart.com/notizia.asp/IDNotizia/16552/IDCategoria/204

http://www.festaeuropeadellamusica.com/ilprogramma.htm

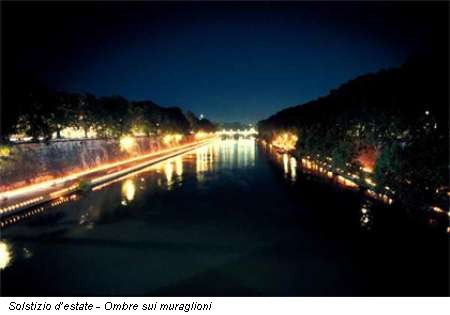

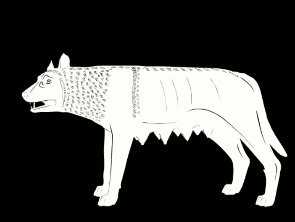

Fotogrammi delle lupe animate di Kristin Jones proiettate sui muraglioni del Tevere

nonSpaziononTempo_part1.mp3 nonSpaziononTempo_part2.mp3 nonSpaziononTempo_part3.mp3

[...] Il tratto rettilineo del Tevere, lo spazio urbano tra Ponte

Sisto e Ponte Mazzini, diventa “piazza fluviale” per le arti contemporanee.

Denominata Piazza Tevere. È il progetto Tevereterno, diretto da

Kristin Jones e curato da Gaia Cianfanelli, con lo scopo di collaborare alla

rinascita del fiume restituendo forma e voce ad una tratto del centro di Roma.

Un progetto artistico di respiro internazionale che mette la città al centro di

un’operazione di arte pubblica mai sperimentata prima in Italia. Inaugurato il

21 giugno 2005 con l’opera ambientale Solstizio d’estate: Ombre sui

muraglioni, Tevereterno presenta la seconda tappa, un’opera collettiva - Ombre

dal Lupercale - realizzata per Piazza Tevere grazie al sostegno della

Soprintendenza ai Beni Culturali del Comune di Roma e della DARC. L’operazione

artistica invita il pubblico in una dimensione dove l’acqua, la luce e il

suono fanno del luogo un’opera d’arte. A partire dal tramonto, le animazioni

degli artisti Kiki Smith, Kristin Jones, Francesca Fini, Roberto Catani,

Maureen Selwood, Andrea Biagioni e Gabriele Manecchi, Daniel K. Brown e Erika

Kruger danno vita alla figura della lupa. Le composizioni di Walter

Branchi, Alvin Curran, David Monacchi, Nico Muhly, Roberto Laneri ed Eugenio

Giordani fanno del luogo un ambiente sonoro.

Partecipare con la mia

musica ad un evento così fortemente concentrato sulle rive del fiume Tevere,

che ha idealmente diviso ma anche cresciuto tra le sue sponde le popolazioni

umbre ed etrusche e che ha generato il mito universale della romanità, non può

che creare in me un sentimento di rispetto e devozione. Proprio nel nome di

questo rispetto ho deciso di non

usare alcuna violenza sonora rispetto a tale maestà. Le

lupe animate di Kristin Jones mi hanno suggerito di dar loro una “voce”

senza spazio e senza tempo, per quanto possibile senza inizio e senza fine,

esplorando una infinita serie di suoni elementari prodotti dalla matematica, che

inseguendosi instancabilmente e mescolandosi tra loro potessero proiettare

idealmente attraverso la magia impalpabile della loro natura fisica il duplice e

contrastante concetto di mobilità/immobilità.

Screenshot dell'algoritmo (AFMX)

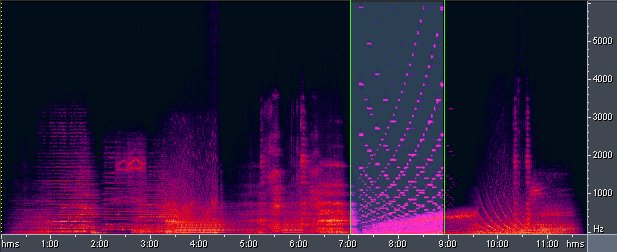

Sonogramma

di Part 3 (la parte evidenziata è ciò

che si ascolta)

VideoDanza

....under construction...

CO2 fa parte di un

progetto realizzato a Pesaro nel 2010 intitolato "Orecchio alla Terra"

(OaT) e ne rappresenta attraverso un'installazione audio-video

i temi in esso contenuti.

OaT è parte di un network internazionale che ha sede a New York denominato Ear to the Earth.

[...] Ear to the Earth è un

network internazionale che fa capo ad un festival annuale nella città

di New York e si connette ad altri eventi nel mondo che trattano

tematiche ambientali.

Gli obiettivi di Ear to the Earth

sono quelli di sostenere iniziative nel campo della musica e dell’arte

sonora riguardanti le tematiche ambientali e di stimolare la coscienza

all’ambiente

attraverso il suono.

Nonostante le veloci mutazioni del clima che si riversano su tutti gli

eco-sistemi, i governi del pianeta non sembrano avere la forza di

veicolare una immediata inversione di tendenza.

Come contributo a tale istanza generale nasce il festival Orecchio alla

Terra, prima edizione italiana ed europea di Ear to the Earth.

Il suono di CO2 è stato prodotto assieme a David Monacchi

(Link ad un estratto del video)

(Link ad un estratto del video)

Nel link seguente è disponibile un'intervista di "Oggiscienza" ad Eugenio Giordani

http://oggiscienza.wordpress.com/2010/06/25/ascoltando-la-terra/

Marenostrum C500T (Musica per video) (2010) (Durata : 12': 30 " )

Una produzione Quatermass(X) : video di Roberto

Vecchiarelli, Luca Vagni, Mariangela Malvaso

Download Download Audio only

Download Download Audio only Mare nostrum è la formula

che indica la certezza, da parte dell'elite dirigente romana, di aver

ridotto tutto il Mediterraneo a un

'lago' romano, controllato dai romani.

L' uso moderno, da parte dell'Italia fascista, della definizione di mare nostrum, indica il programma della rivendicazione della

politica estera mussoliniana, dopo il consolidarsi del suo disegno. E'

l'esempio della riutilizzazione della realtà di Roma antica da

parte della macchina politico-propagandistica del fascismo.

Mare nostro indica l'aspirazione italiana al predominio sul mare e alla estensione della sua area geopolitica innanzitutto sul

versante dell' Adriatico: diritto di sovranità territoriale di Roma sul mare Mediterraneo.

Ma in questo mare, cosa ereditiamo dai deliri di potenza del governo fascista? Una grande quantità di bombe che, sommerse,

continuano da sessant'anni a disperdere lentamente il loro carico di morte.

Gas Iprite, in milioni di litri. Tante bombe scaricate in mare, dai

belligeranti e dai tedeschi in ritirata, per non lasciarle nelle mani

degli Alleati.

Il suono elettronico : il

suono di Marenostrum è realizzato interamente con suoni di sintesi

prodotti da uno strumento software creato dall'autore e che rappresenta

ora il principale strumento di sintesi che caratterizzano gran parte

della recente produzione. Il suono viene generato da un algoritmo

denominato StriaCS (in onore a John Chowning)

ed è stato concepito per creare masse sonore in trasformazione

continua. Vengono impiegate strutture spettrali armoniche,

geometriche e la serie di Fibonacci.

Tutte le trasformazioni del suono sono realizzate

attraverso un sistema di "morphing" strutturale di notevole

complessità. La principale caratteristica di questo tipo di

generazione consiste

nella possibilità di creare un tessuto sonoro omogeneo e coerente, ma allo stesso tempo sempre dinamicamente in evoluzione.

Il lavoro è stato presentato nel 2010 in forma di

installazione al Festival "Orecchio alla Terra" (Pesaro/NewYork)

gemellato con "Ear to The Earth" e recentemente alla Sala Puccini diel

Conservatorio Verdi di Milano

per la rassegna "L'Elettroacustica Domani" a cura di Musica/Realtà e introdotta da Luigi Pestalozza.

Dalla Gazzetta Musicale di Milano :

...Anche

quest’anno, l’ultimo convegno e concerto della stagione

dell’Associazione degli Amici di Musica/Realtà porta alla luce la

questione della musica elettroacustica, della sua ricezione e dei suoi

possibili sviluppi futuri.

I pezzi presentati durante la

serata di chiusura erano sei, tutti più o meno della durata di 10

minuti e tutti di compositori presenti in sala.

In generale, il livello dei brani

proposti è buono, ma tra queste spicca Mare Nostrum C500T di Eugenio

Giordani, legata ad un video di Roberto Vecchiarelli che denuncia la

presenza di bombe chimiche della seconda Guerra Mondiale nel

Mediterraneo: le immagini, proposte a ripetizione in tre quadranti,

rappresentano situazioni contrastanti (per esempio bagnanti/guerra) e i

suoni elettroacustici si adeguano e evidenziano con forza alcuni

dettagli, enfatizzando il significato già di per sé molto forte delle

immagini....

Intus Labor (12 pezzi facili)

Intus Labor è un lavoro collegato alla mostra omonima inaugurata a Pesaro il 4 Dicembre 2010. Il titolo allude, rovesciandolo,

a quello di una famosa raccolta di poesie di Edoardo Sanguineti

(Laborintus) e indica quel lavoro, impresa o travaglio (labor)

non appariscenti che stanno dentro, all’interno (intus) di una

biblioteca storica, in questo caso l’Oliveriana di Pesaro, che è anche

museo

e archivio. La mostra è costituita innanzi tutto da circa 3500 immagini

scelte tra le migliaia di foto catturate da Roberto Vecchiarelli

nel corso di una “residenza” durata molti mesi nei labirinti del

secolare istituto. Gli oggetti, gli scorci, i punti di vista presentano

una vera e

propria “terra incognita” perlustrata anche dalla videocamera messa in

movimento da Mariangela Malvaso, Luca vagni e Roberto Vecchiarelli

Quatermass(x), film proiettato continuamente al centro del grande

pannello che si intravvede dal colonnato della Galleria/Pescheria. La

parte sonora

è ottenuta dalla combinazione di un tessuto sintetico e da materiali

derivanti dalla registrazione dei suoni ambientali del

Conservatorio Rossini, struttura

confinante con la Biblioteca. Il materiale concreto è utilizzato sia in

forma di soundscape che in forma trasfigurata (elaborazione).

(Link al video)

(Link al video) (Link al video- Excerpt 3')

(Link al video- Excerpt 3')[Precedente] [Successivo] [Sommario] [Back]

Eugenio Giordani

Aggiornato il: 25-07-13 .